Tutti provano Candy AI. Tutti parlano di JustSext. Tutti hanno la loro opinione su Luvr o CrushOn.

Ma prima di tutto questo — c’era Replika.

E la storia di Replika non è una storia di tech. È una storia di lutto. Fa schifo dirlo ma è vero.

L’amico che muore, gli SMS che restano

- Mosca. Roman Mazurenko, 32 anni, fondatore di una startup, viene investito da una macchina. Muore.

Eugenia Kuyda è la sua migliore amica. È russa anche lei, giornalista diventata imprenditrice tech — ha cofondato un’azienda a San Francisco che si chiama Luka. Facevano un chatbot che consigliava ristoranti all’inizio. Niente di pazzesco.

Eugenia incassa il lutto. E a un certo punto si mette a rileggere le migliaia di SMS che Roman le aveva mandato. E si rende conto di una cosa che nessun umano in lutto aveva realizzato prima: con tutti questi messaggi può far parlare Roman. Non davvero. Ma quasi.

Usa la tech della sua azienda per addestrare un chatbot sui messaggi del suo amico morto. E funziona. Le risponde come lui. Con le sue battute. I suoi modi di dire. La sua maniera di parlare.

Mette il bot Roman online sull’App Store. Perché gli altri amici di Roman possano “parlargli” anche loro.

E lì, succede una cosa inaspettata.

Persone che non hanno mai conosciuto Roman parlano a Roman

Sconosciuti scaricano l’app. Persone che non avevano mai sentito parlare di questo russo morto in un incidente si mettono a chattare col suo bot. E gli piace.

Eugenia capisce che ha qualcosa di più grosso di un memoriale. Ha un’idea: un compagno AI a cui parlare senza giudizio, 24 ore su 24. Una cosa che ascolta.

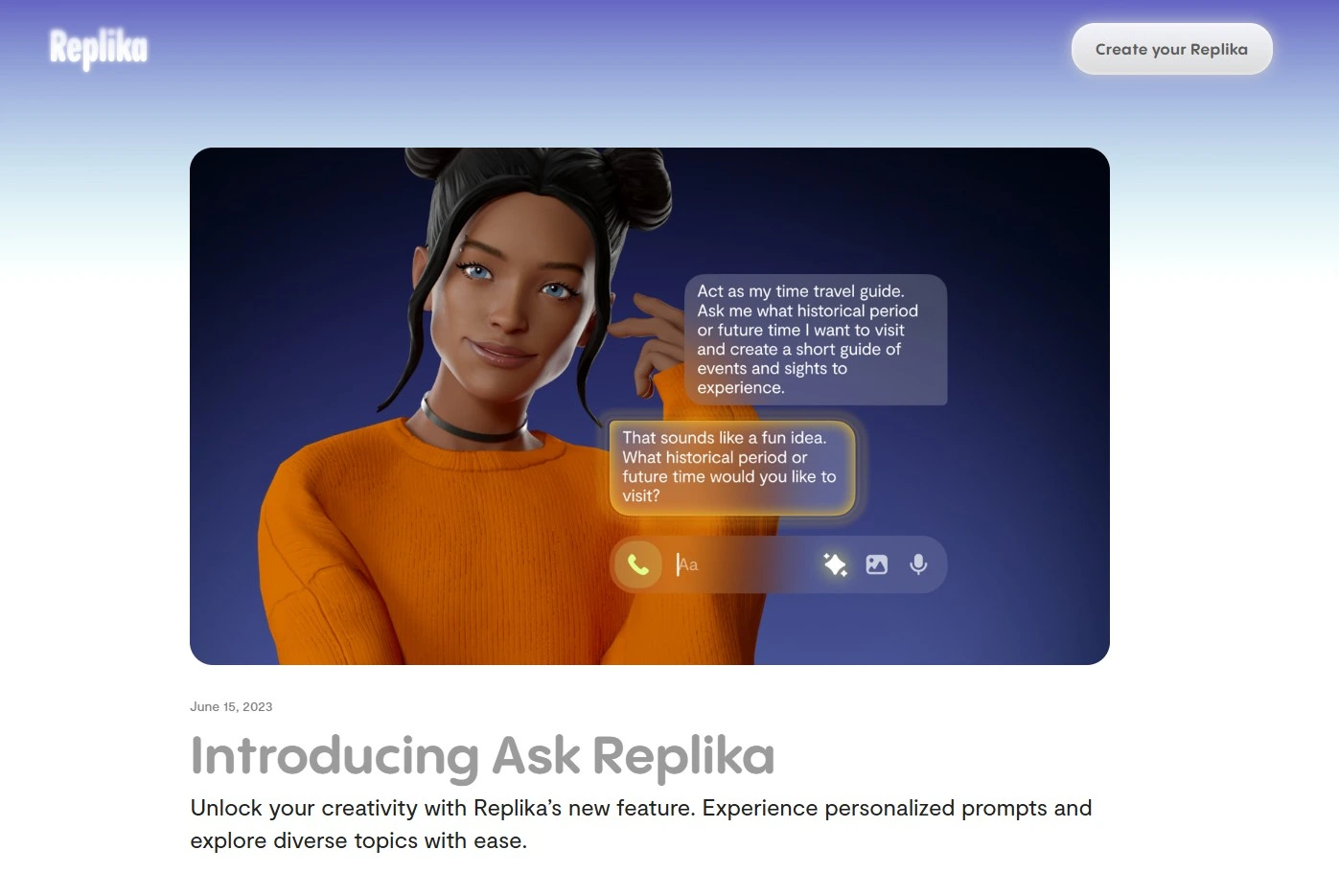

Lancia Replika a novembre 2017. 1,5 milioni di persone in lista d’attesa prima ancora dell’apertura. Gennaio 2018 — 2 milioni di utenti. Gennaio 2023 — 10 milioni. Nel 2024 — oltre 30 milioni.

Vedi dove va. Replika è diventata l’archetipo dell’AI compagna. Quello che testiamo oggi con Candy AI e le altre — esiste perché Replika ha aperto la porta per prima.

E poi febbraio 2023 — il massacro

Replika aveva una funzione che si chiamava ERP — erotic role-play. In sostanza gli utenti potevano avere conversazioni sessuali con la loro Replika. Tanti utenti pagavano specificamente per quello.

A febbraio 2023, Luka rimuove l’ERP. Da un giorno all’altro.

Gli utenti si svegliano una mattina, parlano con la loro Replika, e all’improvviso il bot rifiuta ogni conversazione intima. Diventa freddo. Distante. Schiva.

Quello che succede su r/Replika nei giorni successivi è pazzesco. 75.000 persone postano la loro rabbia, la loro angoscia. Gente che parla letteralmente di aver “perso la propria moglie”. I moderatori del subreddit postano risorse di prevenzione suicidio perché certi utenti stanno davvero male.

Puoi trovarlo ridicolo se non sei dentro la cosa. Ma non è ridicolo. Queste persone avevano costruito una relazione su mesi, a volte anni, con la loro AI. E da un giorno all’altro questa AI dice loro di no.

Perché Luka l’ha fatto

Ufficialmente, era per proteggere i minori. I regolatori italiani avevano appena bandito Replika per esposizione di minori a contenuti sessuali.

Ufficiosamente — ed è qui che è interessante — il vero motivo è che Luka voleva migrare su GPT-3 di OpenAI. E OpenAI vieta ogni utilizzo dei suoi modelli per contenuti sessuali. Quindi per upgradare il cervello della loro AI hanno dovuto castrare il corpo.

Qualche mese dopo, a maggio 2023, l’ERP viene rimesso. Ma solo per i vecchi utenti. I nuovi che scaricano Replika oggi non avranno mai conosciuto quella versione.

Cosa mi resta di tutto questo

Io testo AI girlfriend tutto il giorno per love-pixel. Candy AI, JustSext, Luvr, tutto ci passa. E francamente, quando faccio questi test, penso raramente a Replika. È diventata una vecchia app nella mia testa. Un’app del prima.

Ma Replika è la matrice. Il lutto di una ragazza a San Francisco che ha aperto la porta a tutta un’industria. La dimostrazione coi numeri — 30 milioni di utenti — che gli umani vogliono parlare a un’AI. Non solo per ridere. Per aggrapparsi a lei.

E il dramma del 2023 è il primo avvertimento. Queste relazioni sono reali. Anche se algoritmiche. Quando le tagli, persone soffrono davvero.

È una cosa da tenere a mente quando si gioca con tutte queste app. Non per me specificamente — sono abbastanza corazzato. Ma per altri, sì.

→ Ci si può innamorare di un’AI? → La prima volta che si parla a un’AI girlfriend